Deepfakes y la nueva carrera armamentista de detección y creación de medios falsos generada por IA

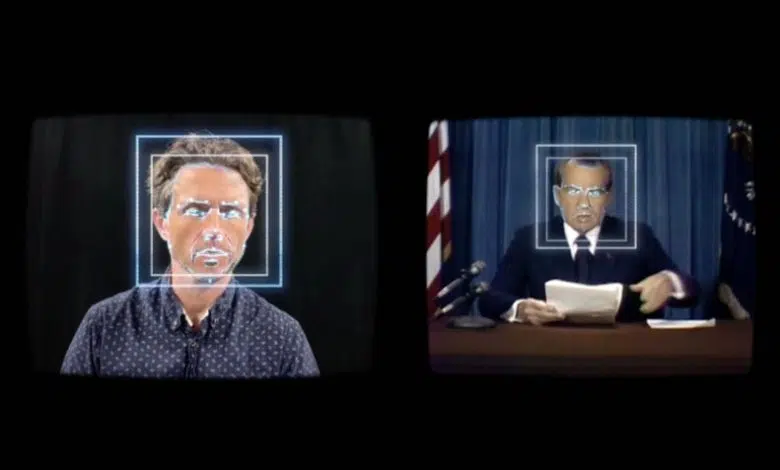

Los videos falsificados creados por IA, en particular, por redes neuronales profundas (DNN), son un giro reciente al desconcertante problema de la desinformación en línea. Aunque la fabricación y la manipulación de imágenes y videos digitales no son nuevas, el rápido desarrollo de la tecnología de inteligencia artificial en los últimos años ha hecho que el proceso para crear videos falsos convincentes sea mucho más fácil y rápido. Los videos falsos generados por IA llamaron la atención del público por primera vez a fines de 2017, cuando una cuenta de Reddit con el nombre Deepfakes publicó videos pornográficos generados con un algoritmo de intercambio de rostros basado en DNN. Posteriormente, el término falso profundo se ha utilizado de manera más amplia para referirse a todos los tipos de videos de suplantación de identidad generados por IA.

Si bien existen aplicaciones interesantes y creativas de las falsificaciones profundas, también es probable que se conviertan en armas. Estuvimos entre los primeros en responder a este fenómeno y desarrollamos el primer método de detección de deepfake basado en la falta de parpadeo realista en las primeras generaciones de videos deepfake. a principios de 2018. Posteriormente, existe un gran interés en el desarrollo de métodos de detección de falsificaciones profundas.

DESAFÍO DE DETECCIÓN

El clímax de estos esfuerzos es el Deepfake Detection Challenge de este año. En general, las soluciones ganadoras son un tour de force de DNN avanzados (una precisión promedio de 82.56 por ciento por el mejor desempeño). Estos nos brindan herramientas efectivas para exponer deepfakes que son automatizados y producidos en masa por algoritmos de IA. Sin embargo, debemos ser cautelosos al leer estos resultados. Aunque los organizadores han hecho todo lo posible para simular situaciones en las que se implementan videos falsos en la vida real, aún existe una discrepancia significativa entre el rendimiento del conjunto de datos de evaluación y un conjunto de datos más reales; cuando se probó en videos no vistos, la precisión del mejor desempeño se redujo al 65.18 por ciento.

Además, todas las soluciones se basan en diseños inteligentes de DNN y aumentos de datos, pero brindan poca información más allá de los algoritmos de clasificación de tipo «caja negra». Además, estos resultados de detección no reflejan el rendimiento de detección real del algoritmo en un solo video falso profundo, especialmente los que se procesaron y perfeccionaron manualmente después de generarse a partir de los algoritmos de IA. Es más probable que estos videos falsos «elaborados» causen daños reales, y el posprocesamiento manual cuidadoso puede reducir o eliminar los artefactos en los que se basan los algoritmos de detección.

DEEPFAKES Y ELECCIONES

La tecnología para hacer deepfakes está a disposición de los usuarios comunes; Hay bastantes herramientas de software disponibles gratuitamente en GitHub, incluidas FakeApp, DFaker, Faceswap-GAN, Faceswap y DeepFaceLab, por lo que no es difícil imaginar que la tecnología podría usarse en campañas políticas y otros eventos sociales importantes. Sin embargo, si vamos a ver algún tipo de videos falsos en las próximas elecciones estará determinado en gran medida por consideraciones no técnicas. Un factor importante es el costo. Crear deepfakes, aunque mucho más fácil que nunca, aún requiere tiempo, recursos y habilidad.

En comparación con otros enfoques más económicos para la desinformación (p. ej., reutilizar una imagen o video existente en un contexto diferente), las falsificaciones profundas siguen siendo una tecnología costosa e ineficiente. Otro factor es que los videos deepfake generalmente pueden exponerse fácilmente mediante la verificación de datos de fuentes cruzadas y, por lo tanto, no pueden crear efectos duraderos. Sin embargo, aún debemos estar alertas a los videos falsos elaborados que se utilizan en una campaña de desinformación extensa o que se implementan en un momento determinado (por ejemplo, unas pocas horas después de la votación) para causar confusión y caos a corto plazo.

DETECCIÓN FUTURA

La competencia entre la creación y detección de deepfakes no terminará en un futuro previsible. Veremos deepfakes más fáciles de hacer, más realistas y más difíciles de distinguir. El cuello de botella actual por la falta de detalles en la síntesis se superará mediante la combinación con los modelos GAN. El tiempo de formación y generación se reducirá con los avances en hardware y en estructuras de redes neuronales más ligeras. En los últimos meses, estamos viendo nuevos algoritmos que pueden ofrecer un nivel de realismo mucho más alto. o ejecutar casi en tiempo real. La última forma de videos falsos profundos irá más allá del simple intercambio de caras, a la síntesis de cabeza completa (títeres de cabeza), síntesis audiovisual conjunta (cabezas parlantes) e incluso síntesis de cuerpo completo.

Además, los deepfakes originales solo están destinados a engañar a los ojos humanos, pero recientemente hay medidas para hacerlos también indistinguibles para los algoritmos de detección. Estas medidas, conocidas como contraforenses, aprovechan la fragilidad de las redes neuronales profundas al agregar «ruido» invisible específico al video falso profundo generado para engañar al detector basado en la red neuronal.

Para frenar la amenaza que representan los deepfakes cada vez más sofisticados, la tecnología de detección también deberá seguir el ritmo. A medida que tratamos de mejorar el rendimiento general de la detección, también se debe hacer hincapié en aumentar la solidez de los métodos de detección para la compresión de video, el lavado de redes sociales y otras operaciones comunes de procesamiento posterior, así como las operaciones contraforenses intencionales. Por otro lado, dada la velocidad de propagación y el alcance de los medios en línea, incluso el método de detección más efectivo operará en gran medida a posteriori, aplicable solo después de que surjan videos falsos profundos.

Por lo tanto, también veremos desarrollos de enfoques más proactivos para proteger a las personas de convertirse en víctimas de tales ataques. Esto se puede lograr «envenenando» los posibles datos de entrenamiento para sabotear el proceso de entrenamiento de los modelos de síntesis deepfake. Las tecnologías que autentican videos originales usando marcas de agua digitales invisibles o control de captura también verán un desarrollo activo para complementar los métodos de detección y protección.

No hace falta decir que los deepfakes no son solo un problema técnico y, como se ha abierto la caja de Pandora, no van a desaparecer en un futuro previsible. Pero con mejoras técnicas en nuestra capacidad para detectarlos y una mayor conciencia pública sobre el problema, podemos aprender a coexistir con ellos y limitar sus impactos negativos en el futuro.