Los científicos dan un paso hacia la decodificación del habla del cerebro

Los accidentes cerebrovasculares, la esclerosis lateral amiotrófica y otras enfermedades pueden privar a las personas de la capacidad de hablar. Su comunicación se limita a la velocidad a la que pueden mover el cursor con los ojos (solo de 8 a 10 palabras por minuto), mientras que la velocidad natural del habla es de 120 a 150 palabras por minuto. Ahora, aunque el lenguaje natural aún está muy lejos, los investigadores de la Universidad de California en San Francisco han generado oraciones inteligibles de la mente de personas sin barreras lingüísticas.

El trabajo proporciona una prueba de principio de que algún día debería ser posible convertir palabras imaginarias en habla inteligible en tiempo real, sin pasar por los mecanismos del sonido, dijo Edward Chang, neurocirujano de la Universidad de California en San Francisco, y coautor del estudio. autor en abril publicado en naturaleza, dijo en una conferencia de prensa. «Pocos de nosotros entendemos realmente lo que está pasando en nuestra boca cuando hablamos», dijo. «El cerebro traduce estos pensamientos de lo que quieres decir en movimientos del tracto vocal, y eso es lo que queremos decodificar».

Pero Chang advierte que la tecnología, que solo ha sido probada en personas con habilidades típicas del habla, puede ser más difícil de trabajar en personas que no pueden hablar, especialmente aquellas que nunca pueden hablar debido a trastornos del movimiento como el cerebro de la persona. . parálisis.

Chang también enfatizó que su método no se puede usar para leer la mente de una persona, solo para traducir lo que la persona quiere decir en una voz audible. «Otros investigadores han tratado de ver si es realmente posible simplemente decodificar los pensamientos», dijo. * «Resultó ser un problema muy difícil y desafiante. Es solo una de las muchas razones por las que nos enfocamos en lo que la gente quiere decir».

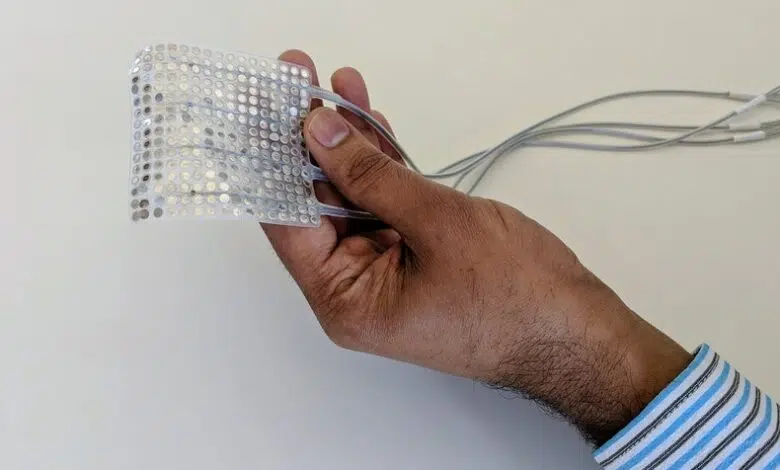

Chang y sus colegas idearon un método de dos pasos para convertir los pensamientos en palabras. Primero, en pruebas con personas con epilepsia que usaron electrodos en la superficie del cerebro para medir la actividad neuronal, los investigadores registraron señales de áreas del cerebro que controlan los músculos de la lengua, los labios y la garganta. Más tarde, tradujeron esas acciones en oraciones audibles utilizando algoritmos informáticos de aprendizaje profundo entrenados en lenguaje hablado natural.

En este punto, se tendría que entrenar un sistema de decodificación en el cerebro de cada individuo, pero la traducción a sonidos podría generalizarse en toda la persona, dijo el coautor Gopala Anumanchipalli de la Universidad de California en San Francisco.temas, pero La representación a continuación se puede compartir, que es lo que explora nuestro artículo», dijo.

Los investigadores pidieron a hablantes nativos de inglés que transcribieran oraciones que escucharon en el mercado de crowdsourcing de Mechanical Turk de Amazon. El estudio encontró que cuando se les dio un conjunto de 25 palabras posibles para elegir, los oyentes tenían un 43 por ciento de posibilidades de escuchar la oración correctamente, y un 21 por ciento de las veces cuando se les dieron 50 palabras.

Si bien la precisión sigue siendo baja, es suficiente para tener un impacto significativo en las personas «bloqueadas» que están casi completamente paralizadas y no pueden hablar, dijeron los investigadores. «Para las personas que están encerradas y no pueden comunicarse en absoluto, algunos pequeños errores son aceptables», dijo Marc Slutzky, neurólogo y neuroingeniero de la Facultad de Medicina Feinberg de la Universidad Northwestern, quien publicó el estudio pero no participó en el nuevo estudiar. «Incluso unos pocos cientos de palabras serían una gran mejora», dijo. «Obviamente quieres [be able to] Di la palabra que quieras, pero aún así es mucho mejor que escribir una letra a la vez, que es [current] lo último. «

Incluso si los voluntarios no escuchaban las oraciones con total precisión, las frases tendían a tener significados similares a los pronunciados en silencio. Por ejemplo, los «conejos» se llaman «roedores», dijo en un comunicado de prensa Josh Chattier, de la Universidad de California en San Francisco, otro coautor del estudio. Los sonidos como «sh» en «ship» se decodificaron particularmente bien, mientras que los sonidos como «th» en «the» fueron especialmente desafiantes, agregó Chartier.

Varios otros grupos de investigación en los EE. UU. y en otros lugares también han logrado un progreso significativo en la decodificación del habla, pero el nuevo estudio marca la primera vez que una oración completa se interpreta correctamente, según Slutzky y otros científicos que no participan en el trabajo.

«Creo que este documento es un ejemplo de cómo el pensamiento puede aprovechar El poder de la biología y el aprendizaje automático», dijo Leigh Hochberg, neurocientífica del Hospital General de Massachusetts en Boston y neurocientífica de la Universidad de Brown y el Centro Médico Providence VA. Hochberg no participó en el trabajo.

El estudio ha causado revuelo en el campo, pero los investigadores dicen que la tecnología aún no está lista para los ensayos clínicos. «En los próximos 10 años, creo que veremos sistemas que mejorarán la capacidad de comunicación de las personas», dijo Jaimie Henderson, profesora de neurocirugía en la Universidad de Stanford que no participó en el nuevo estudio. Dijo que los desafíos pendientes incluyen determinar si la decodificación del habla mejoraría utilizando un análisis más detallado de la actividad cerebral; desarrollar un dispositivo que podría implantarse en el cerebro y decodificar el habla en tiempo real; y extender los beneficios a las personas que pueden no hablan en absoluto (no pueden hablar en absoluto). el cerebro no está listo para hablar).

Hochberg dijo que piensa en lo que está en juego en este tipo de investigación: «Cada vez que estoy en una unidad de cuidados neurointensivos, veo a alguien que podría haber tenido problemas para caminar y hablar ayer, pero tuvo un derrame cerebral y no puede moverse ni hablar por mucho más tiempo ahora. . » Aunque deseaba que el trabajo avanzara más rápido, Hochberg dijo que estaba satisfecho con el progreso en el campo. «Creo que habrá muchas oportunidades para que las interfaces cerebro-computadora ayuden a las personas y, con suerte, rápidamente».

*Nota del editor (24 de abril de 2023): esta cita ha sido actualizada. Chang aclaró su declaración original y señaló que su laboratorio no está tratando de decodificar la mente solo.